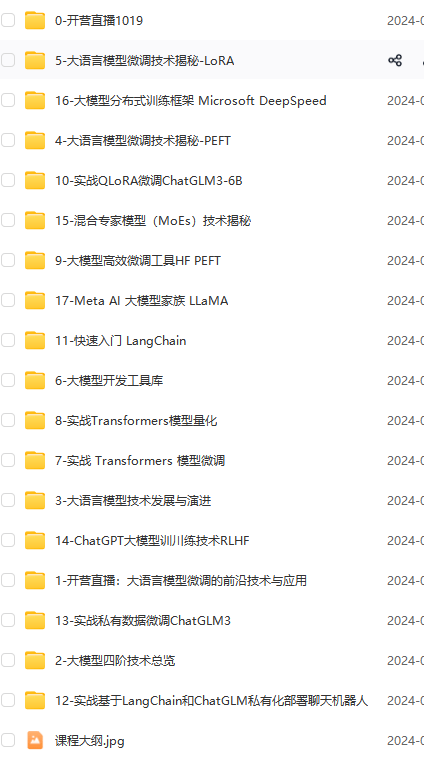

课程目录:

├──0-开营直播1019

| ├──大厂案例PPT

| | ├──360 大数据平台定制开发之道.pdf 811.72kb

| | ├──DDD 在京东物流的落地效果.pdf 965.99kb

| | ├──Go 并发数据结构和算法实践.pdf 662.06kb

| | ├──Go 语言基础原理深度解析.pdf 479.82kb

| | ├──阿里工程效能微创新.pdf 2.09M

| | ├──百度文心 (ERNIE) 语义理解技术详解.pdf 1.43M

| | ├──大疆 Kubernetes 探索与实践之路.pdf 1.92M

| | ├──构建批流一体化 AI 数据平台的深度探索.pdf 1.00M

| | ├──技术管理路上的那些事儿.pdf 1.17M

| | ├──快手 AI 生成式技术实践.pdf 628.98kb

| | ├──类秒杀场景下的瞬时大流量高并发实践.pdf 526.44kb

| | ├──如何建设一支能打硬仗的技术团队.pdf 173.88kb

| | ├──腾讯万亿级 Elasticsearch 架构实践.pdf 1.32M

| | ├──推荐系统特征交互建模:浅层模型、深度模型与 AutoML.pdf 2.46M

| | ├──微保 Service Mesh 研发实践中的取舍-龙武_compressed.pdf 598.75kb

| | └──研发效能建设的“灵魂拷问”与落地实践.pdf.pdf 1.31M

| ├──10.19直播答疑部分.mp4 555.38M

| └──RAG、微调、预训练,如何选择适合的大模型优化方式?.mp4 1.15G

├──1-开营直播:大语言模型微调的前沿技术与应用

| ├──代码

| ├──课件

| | └──开营直播:大语言模型微调的前沿技术与应用.pdf 9.91M

| ├──视频

| | └──01-大模型微调的前沿技术与应用.mp4 1.42G

| ├──直播评论

| | └──20231129评论区记录.xlsx 16.46kb

| └──资料

├──10-实战QLoRA微调ChatGLM3-6B

| ├──代码

| | └──github.txt 0.04kb

| ├──课件

| | └──9-实战QLoRA 微调 ChatGLM3-6B.pdf 14.08M

| ├──视频

| | ├──1月3日.mp4 2.61G

| | └──AI 大模型微调训练营第 0 期直播课-6.flv 1.79G

| ├──直播评论

| | └──20240103评论区记录.xlsx 10.46kb

| └──资料

| | └──GLM论文.zip 8.44M

├──11-快速入门 LangChain

| ├──代码

| ├──课件

| | └──10-快速入门 LangChain 大模型应用开发框架.pdf 9.68M

| ├──视频

| | ├──1月7日-2.mp4 1.53G

| | └──1月7日.mp4 730.85M

| ├──直播评论

| └──资料

├──12-实战基于LangChain和ChatGLM私有化部署聊天机器人

| ├──代码

| ├──课件

| | └──11-实战基于LangChain和ChatGLM私有化部署聊天机器人.pdf 10.60M

| ├──视频

| | └──1月10日.mp4 3.82G

| └──直播评论

| | └──20240110评论区记录.xlsx 13.45kb

├──13-实战私有数据微调ChatGLM3

| ├──代码

| | └──代码.txt 0.04kb

| ├──课件

| | └──12-实战私有数据微调ChatGLM3.pdf 10.02M

| ├──视频

| | └──1月18日.mp4 4.85G

| ├──直播评论

| | └──20240118评论区记录.xlsx 14.25kb

| └──资料

├──14-ChatGPT大模型训川练技术RLHF

| ├──代码

| | └──代码.txt 0.04kb

| ├──课件

| | └──13-ChatGPT大模型训练技术RLHF.pdf 6.45M

| ├──视频

| | └──1月21日.mp4 3.49G

| ├──直播评论

| | └──20240121评论区记录.xlsx 13.25kb

| └──资料

├──15-混合专家模型(MoEs)技术揭秘

| ├──课件

| | └──14-混合专家模型(MoEs)技术揭秘.pdf 5.37M

| ├──视频

| | └──1月25日.mp4 3.39G

| ├──直播评论

| | └──20240124评论区记录.xlsx 11.35kb

| └──资料

| | └──MoEs论文.zip 7.67M

├──16-大模型分布式训练框架 Microsoft DeepSpeed

| ├──代码

| | └──代码.txt 0.04kb

| ├──课件

| | └──15-大模型分布式训练框架Microsoft DeepSpeed(1).pdf 7.78M

| ├──视频

| | └──1月28日.mp4 6.36G

| ├──直播评论

| | └──20240128评论区记录.xlsx 12.74kb

| └──资料

| | └──ZeRO论文.zip 2.84M

├──17-Meta AI 大模型家族 LLaMA

| ├──代码

| ├──课件

| | └──16-Meta AI 大模型家族 LLaMA.pdf 8.60M

| ├──视频

| | └──1月31日.mp4 3.13G

| ├──直播评论

| | └──20240131评论区记录.xlsx 11.75kb

| └──资料

| | └──LLaMAl论文.zip 15.27M

├──2-大模型四阶技术总览

| ├──课件

| | ├──1-AI大模型四阶技术总览-新.pdf 18.91M

| | └──1-AI大模型四阶技术总览.pdf 20.74M

| ├──视频

| | └──AI大模型四阶技术总览.mp4 2.96G

| ├──直播评论

| | └──20231203评论区记录.xlsx 17.14kb

| └──资料

├──3-大语言模型技术发展与演进

| ├──课件

| | └──2-大语言模型技术发展与演进.pdf 17.79M

| ├──视频

| | └──大模型演进.mp4 2.92G

| ├──直播评论

| | └──20231203评论区记录.xlsx 17.14kb

| └──资料

| | └──论文.zip 9.97M

├──4-大语言模型微调技术揭秘-PEFT

| ├──代码

| ├──课件

| | ├──2-大语言模型技术发展与演进.pdf 17.79M

| | └──3-大模型微调技术揭秘-PEFT.pdf 10.05M

| ├──视频

| | ├──大模型微调技术揭秘-PEFT.mp4 4.58G

| | └──新录制1月14日.mp4 3.69G

| ├──直播评论

| | └──20231206评论区记录.xlsx 14.27kb

| └──资料

| | └──Fine-tuning论文.zip 16.51M

├──5-大语言模型微调技术揭秘-LoRA

| ├──代码

| ├──课件

| | ├──3-大模型微调技术揭秘.pdf 16.20M

| | └──4-大模型微调技术揭秘-LoRA.pdf 7.54M

| ├──视频

| | └──大模型低秩适配(LoRA)技术.mp4 4.33G

| ├──直播评论

| | └──20231210评论区记录.xlsx 16.01kb

| └──资料

| | └──UniPELT A Unified Framework for Parameter-Efficient Language Model Tuning.pdf 444.46kb

├──6-大模型开发工具库

| ├──代码

| ├──课件

| | └──5-大模型开发工具库 HF Transformers.pdf 4.44M

| ├──视频

| | └──大模型开发工具.mp4 3.11G

| └──直播评论

├──7-实战 Transformers 模型微调

| ├──代码

| | └──github.txt 0.04kb

| ├──课件

| | └──6-实战Transformers模型微调.pdf 4.36M

| ├──视频

| | └──12月13日.mp4 4.28G

| └──直播评论

| | └──20231220评论区记录.xlsx 15.78kb

├──8-实战Transformers模型量化

| ├──代码

| | └──github.txt 0.04kb

| ├──课件

| | └──7-实战Transformers模型量化.pdf 6.37M

| ├──视频

| | └──12月24日.mp4 4.61G

| ├──直播评论

| | └──20231224评论区记录.xlsx 12.46kb

| └──资料

| | └──Quantization论文.zip 5.56M

├──9-大模型高效微调工具HF PEFT

| ├──代码

| | └──github.txt 0.04kb

| ├──课件

| | └──8-大模型高效微调工具HF PEFT.pdf 2.77M

| ├──视频

| | └──12月27日.mp4 4.42G

| └──直播评论

| | └──20231227评论区记录.xlsx 12.81kb

└──课程大纲.jpg 1.42M

网盘截图: